La Inteligencia Artificial (IA) está transformando radicalmente la forma en que se construyen las aplicaciones, y el equipo de .NET se ha comprometido firmemente a seguir el ritmo de los rápidos cambios en la IA generativa. Su prioridad es equipar a los desarrolladores .NET con las herramientas, bibliotecas y guías necesarias para crear aplicaciones inteligentes de vanguardia. El robusto ecosistema .NET se posiciona como una plataforma potente para integrar la IA de manera fluida y eficiente en cualquier tipo de aplicación.

Esta publicación es la primera de una serie dedicada a introducir los pilares fundamentales para la IA en .NET. Estos incluyen:

- Microsoft.Extensions.AI (MEAI): Esencial para un acceso unificado a los Large Language Models (LLM).

- Microsoft.Extensions.VectorData: Clave para la búsqueda semántica y la gestión de embeddings persistentes.

- Microsoft Agent Framework: Diseñado para la creación de flujos de trabajo basados en agentes inteligentes.

- Model Context Protocol (MCP): Un protocolo vital que asegura la interoperabilidad entre diversos componentes de IA.

En este post inaugural, nos centraremos en explorar en profundidad Microsoft.Extensions.AI (MEAI), la biblioteca fundacional para interactuar con la IA generativa en .NET. MEAI no solo sustituye las primitivas y características universales que se introdujeron inicialmente con Semantic Kernel, sino que también integra exitosamente patrones de desarrollo ya consolidados y familiares para los desarrolladores .NET, como la inyección de dependencias, el uso de middleware y los patrones de constructor. Estos patrones son pilares en tecnologías web modernas como ASP.NET, las API mínimas y Blazor, asegurando una experiencia de desarrollo coherente y eficiente.

Una API Unificada para Múltiples Proveedores de LLM

Una de las características más revolucionarias de MEAI es su capacidad para ofrecer una API unificada. Esto significa que los desarrolladores ya no necesitan lidiar con la complejidad de múltiples SDKs específicos de cada proveedor. En su lugar, pueden interactuar con diversos Large Language Models de plataformas como OpenAI, OllamaSharp y Azure OpenAI a través de una única abstracción común. Por ejemplo, mientras que la interacción directa con OllamaSharp o OpenAI típicamente requiere el uso de sus clientes nativos, MEAI simplifica radicalmente este proceso. Aunque el cliente de chat de OllamaSharp ya es compatible con la interfaz universal IChatClient, para el cliente de OpenAI, la biblioteca proporciona un práctico método de extensión en el adaptador de OpenAI (Microsoft.Extensions.AI.OpenAI) que permite adaptarlo fácilmente a IChatClient. Como resultado, una vez configurado, el desarrollador puede utilizar la misma API genérica para realizar solicitudes y obtener respuestas, sin importar el proveedor subyacente. Esta estandarización no solo acelera el desarrollo, sino que también facilita la transición entre diferentes servicios de IA o la integración de nuevos proveedores con una mínima reescritura de código.

Más Allá de la Conveniencia: Funcionalidades Integradas Avanzadas

La utilidad de Microsoft.Extensions.AI trasciende la mera abstracción. La biblioteca incorpora funcionalidades avanzadas que se gestionan automáticamente, liberando al desarrollador de tareas repetitivas y complejas. Esto incluye la gestión inteligente de reintentos automáticos en caso de fallos temporales en la comunicación, la administración de límites de tokens para optimizar el rendimiento y controlar los costos, y una integración profunda con los patrones de inyección de dependencias, que simplifica la configuración y el mantenimiento de las aplicaciones de IA.

Un claro ejemplo de su potencia es la facilidad con la que se maneja la salida estructurada. Históricamente, obtener una respuesta de un modelo en un formato específico, como JSON, y luego parsearla, podía ser un proceso tedioso y propenso a errores. Con MEAI, el desarrollador puede definir un esquema de C# claro para la salida esperada. La biblioteca se encarga entonces de garantizar que el modelo genere los datos siguiendo ese formato y, además, realiza automáticamente la deserialización en objetos C# fuertemente tipados. Este enfoque no solo simplifica drásticamente el código del desarrollador, sino que también proporciona al modelo de IA un contexto mucho más preciso sobre la estructura de respuesta deseada, lo que se traduce en una mayor exactitud y relevancia de las respuestas.

Solicitudes y Respuestas Estandarizadas con `ChatOptions`

La biblioteca también unifica y estandariza la forma en que los desarrolladores configuran y controlan las interacciones con los modelos de IA. Parámetros clave como la «temperatura» de un modelo, que es una medida de la aleatoriedad y, por ende, de la creatividad de sus respuestas, se manejan de manera uniforme a través de la clase ChatOptions. Una temperatura baja tiende a producir respuestas más deterministas y fácticas, lo que es ideal para tareas que requieren precisión, como la clasificación de texto o el resumen. Por otro lado, una temperatura más alta introduce mayor variabilidad, lo que puede ser beneficioso para la generación de ideas o tareas más creativas, aunque con un riesgo ligeramente mayor de obtener respuestas «infundadas» o menos precisas. Además de la temperatura, ChatOptions permite ajustar otros parámetros cruciales, como el número máximo de tokens de salida, lo que ayuda a controlar la longitud y el costo de las respuestas. En el lado de la respuesta, cada interacción satisfactoria proporciona una instancia de UsageDetails, permitiendo un seguimiento exacto y transparente del consumo de tokens, una funcionalidad vital para la gestión de recursos y costos en aplicaciones de IA.

Middleware: Extensión y Control Dinámico del Flujo de IA

Los desarrolladores web de .NET ya están profundamente familiarizados con el poder y la flexibilidad del middleware, que funciona como un modelo de «plugins» para interceptar y modificar el flujo de ejecución de una aplicación. En el contexto de MEAI, este concepto se aplica directamente a la interacción con el modelo de IA, permitiendo insertar lógica personalizada en la tubería de comunicación con el modelo. Esto abre un amplio abanico de posibilidades para implementar funcionalidades críticas, tales como:

- Detener contenido malicioso o inapropiado antes de que sea procesado por el modelo.

- Bloquear o limitar solicitudes (conocido como «throttling») para gestionar la carga del sistema y proteger los recursos.

- Proporcionar servicios de telemetría y trazabilidad detallados para monitorear el rendimiento y diagnosticar problemas.

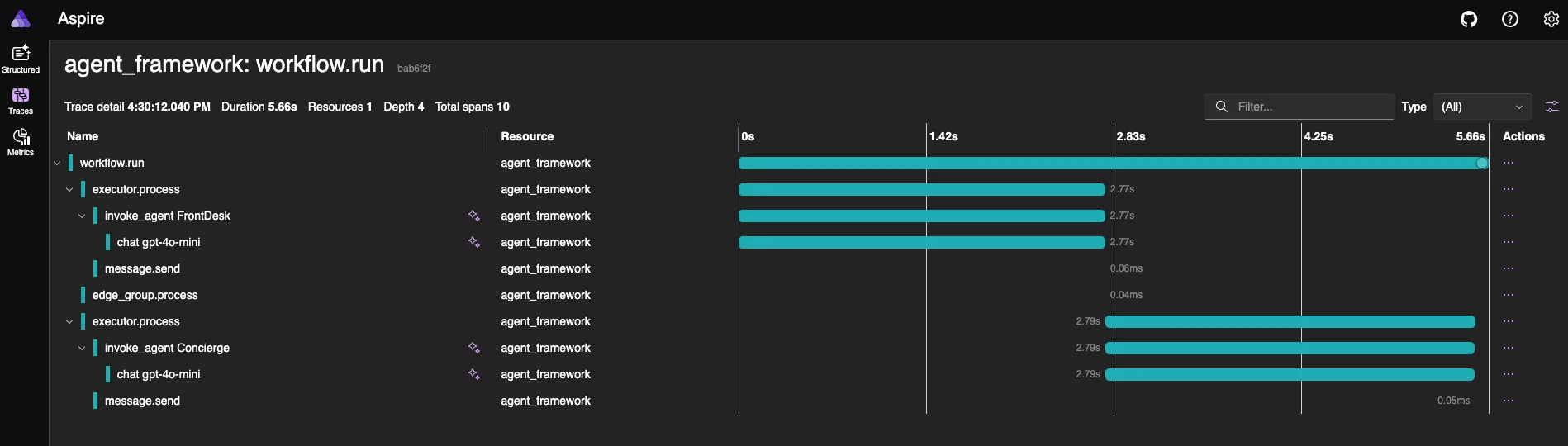

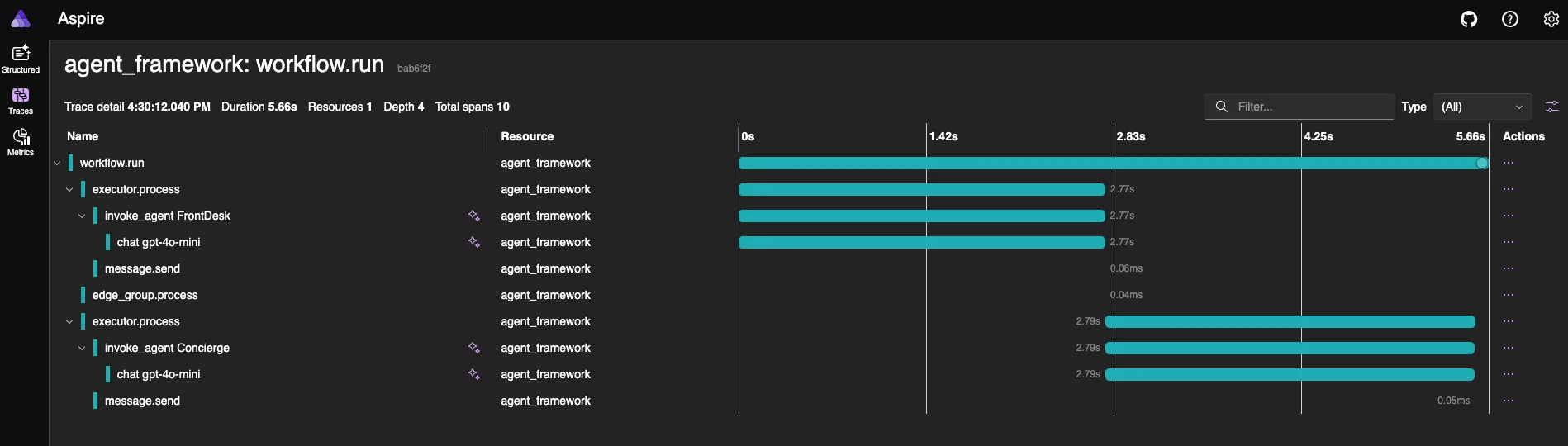

MEAI incluye middleware preconfigurado para telemetría y trazabilidad listo para usar. Utilizando un familiar patrón de constructor, los desarrolladores pueden añadir fácilmente capacidades de logging y la generación de eventos de Open Telemetry (OTEL) a cualquier cliente IChatClient existente. Estos eventos OTEL son compatibles con servicios de monitoreo en la nube como Application Insights y, de forma particularmente útil, se integran con el dashboard de Aspire. Aspire, la plataforma de Microsoft diseñada para la creación de aplicaciones distribuidas, ha sido mejorada para proporcionar un contexto adicional específicamente para aplicaciones inteligentes. En su dashboard, los desarrolladores pueden observar «destellos» visuales que indican las interacciones con los Large Language Models, lo que facilita enormemente el monitoreo, la depuración y la optimización del rendimiento de las aplicaciones de IA.

DataContent para Conversaciones Multimodales Avanzadas

La evolución actual de los modelos de IA ha trascendido la mera interacción basada en texto. Cada vez más, los modelos multimodales están siendo lanzados, capaces de procesar y generar datos en una amplia variedad de formatos, incluyendo imágenes, sonidos y otros tipos de medios. Aunque la mayoría de los ejemplos prácticos de MEAI suelen centrarse en interacciones textuales, representadas por instancias de TextContent, la biblioteca ofrece un conjunto robusto y extensible de tipos de contenido, todos basados en AIContent, para manejar esta diversidad. Entre ellos se encuentran ErrorContent para información detallada de errores, UserInputRequestContent para solicitar interacción del usuario, FunctionCallContent para representar llamadas a herramientas, HostedFileContent para referencias a datos alojados en servicios de IA, y UriContent para enlaces web.

Sin embargo, el tipo de contenido que probablemente resultará más versátil y utilizado para manejar datos multimodales es DataContent. Este tipo está diseñado para encapsular prácticamente cualquier tipo de medio, representándolo como un array de bytes junto con su tipo MIME (media type) correspondiente. Por ejemplo, un desarrollador puede enviar una fotografía (como un archivo JPG) directamente a un modelo de IA, junto con instrucciones textuales claras, para que el modelo la describa detalladamente y genere una lista de etiquetas asociadas. Este potente ejemplo demuestra la flexibilidad inherente de MEAI para construir aplicaciones de IA que no solo se limitan al procesamiento de texto, sino que pueden comprender y procesar el mundo real a través de múltiples modalidades sensoriales, abriendo un vasto abanico de posibilidades para la innovación.

Otras Funcionalidades Destacadas del Núcleo de MEAI

Aunque un análisis exhaustivo de todas sus capacidades excede el alcance de esta publicación introductoria, Microsoft.Extensions.AI proporciona una serie de otras funcionalidades importantes que contribuyen significativamente a la robustez, eficiencia y capacidad de respuesta de las aplicaciones de IA en .NET. Estas incluyen:

- Tokens de cancelación: Componentes esenciales para construir aplicaciones responsivas que pueden abortar operaciones de IA de larga duración cuando ya no son necesarias.

- Manejo de errores y resiliencia integrado: Mecanismos automáticos que aseguran que las aplicaciones puedan recuperarse elegantemente de fallos transitorios o interrupciones inesperadas en la comunicación con los modelos de IA.

- Primitivas para manejar vectores y embeddings: Elementos fundamentales para implementar técnicas avanzadas de IA, como la búsqueda semántica, la recomendación y la comparación de similitudes.

- Generación de imágenes: Capacidades para interactuar directamente con modelos que pueden generar contenido visual a partir de descripciones textuales u otros datos.

Conclusión y Vistazo al Futuro

En resumen, esta publicación ha explorado a fondo Microsoft.Extensions.AI, el bloque de construcción fundamental para el desarrollo de aplicaciones inteligentes en el ecosistema .NET. Hemos visto cómo MEAI simplifica radicalmente la interacción con múltiples proveedores de LLM a través de una API unificada, facilita la obtención de salidas estructuradas, estandariza la configuración del modelo y mejora drásticamente la observabilidad y el diagnóstico a través de su potente sistema de middleware y la integración con Aspire.

Esta es solo la primera entrega de una serie informativa. En las próximas publicaciones, profundizaremos en Microsoft.Extensions.VectorData, donde exploraremos las extensiones relacionadas con vectores y embeddings, y se explicará la lógica detrás de su separación del modelo principal. Posteriormente, se abordarán el Microsoft Agent Framework para la creación de flujos de trabajo inteligentes basados en agentes, y el Model Context Protocol (MCP), fundamental para garantizar la interoperabilidad.

Para aquellos entusiastas que deseen comenzar a construir sus propias aplicaciones inteligentes en .NET, existen múltiples recursos valiosos disponibles:

- Aprender con código: Explora el repositorio de MEAI en GitHub y los ejemplos prácticos de MEAI.

- Tutoriales y guías rápidas: Consulta la documentación oficial de Microsoft Extensions for AI, así como guías para construir una aplicación de chat con IA y crear una aplicación inteligente .NET con datos personalizados usando la plantilla de chat de IA.

- Videos explicativos: Visualiza grabaciones sobre los bloques de construcción de la IA y el desarrollo de aplicaciones inteligentes con .NET.

¡Feliz codificación!